人类对自身的研究和模仿由来已久,在我国2000多年前的《列子·汤问》里就描述了有能工巧匠制作出会说话会舞动的类人机器人的故事。声音包含丰富的个体特征及情感情绪信息,对话作为人类最常使用亲切自然的交互模式,是连接人与智能世界至关重要的环节。

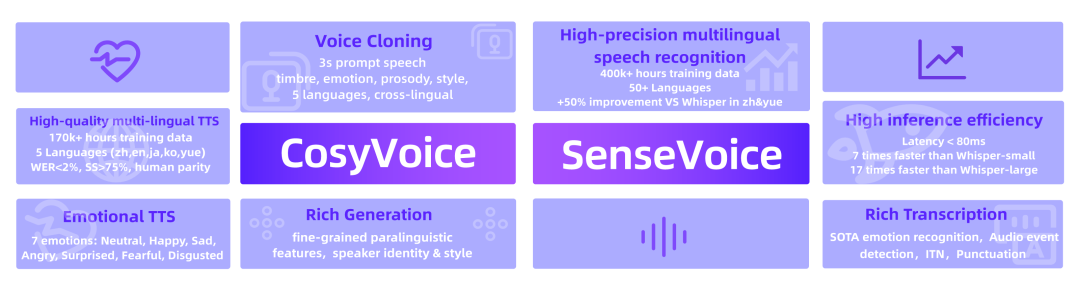

近日,阿里通义实验室发布并开源了语音大模型项目FunAudioLLM,旨在深化人类与大型语言模型(LLMs)之间的自然语音交互体验。这一框架的核心是两个创新模型:SenseVoice和CosyVoice。

CosyVoice 致力于自然语音生成,支持多语言、音色和情感控制,在多语言语音生成、零样本语音生成、跨语言声音合成和指令执行能力方面表现卓越。

多语言合成:采用了总共超15万小时的数据训练,支持中英日粤韩5种语言的合成,合成效果显著优于传统语音合成模型。

极速音色模拟:仅需要3~10s的原始音频,即可生成模拟音色,甚至包括韵律、情感等细节。在跨语种的语音合成中,也有不俗的表现。

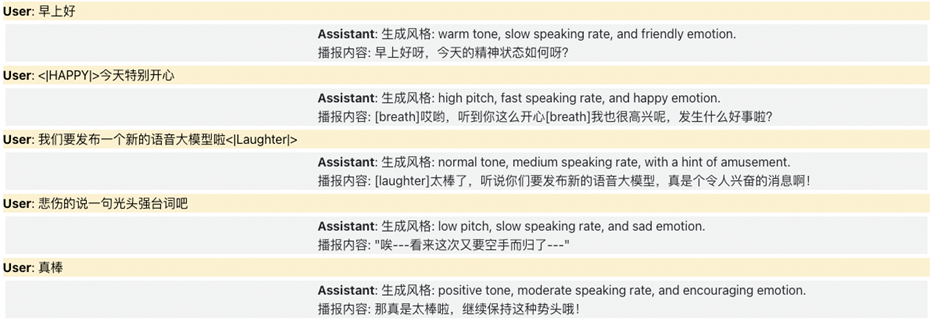

富文本或自然语言的细粒度控制:支持以富文本或自然语言的形式,对合成语音的情感、韵律进行细粒度的控制,合成音频在情感表现力上得到明显提升。

SenseVoice 则专注于高精度多语言语音识别、情感辨识和音频事件检测。

基于SenseVoice和CosyVoice模型,FunAudioLLM可支持较多的人机交互应用场景,例如音色情感生成的多语言语音翻译、情绪语音对话、互动播客、有声读物等。

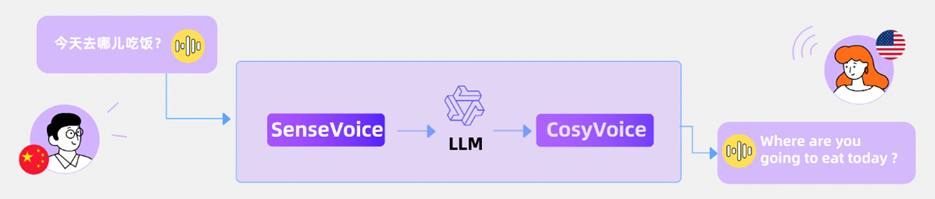

同音交传:模拟音色与情感的多语言翻译

通过结合SenseVoice、LLMs以及CosyVoice,我们可以无缝地进行语音到语音的翻译(S2ST)。需要注意的是,原始录音在文本中会以粗体显示。这种集成化的方法不仅提升了翻译的效率和流畅性,而且通过感知语音中的情感和语调,它能够在译文中复现原始语音的情感色彩,让对话的交流更加真实和动人。

无论是多语种的会议通译、跨文化的交流沟通,还是为非母语者提供即时语音翻译服务,这一技术都将大大缩小语言差距和沟通中的信息减损。

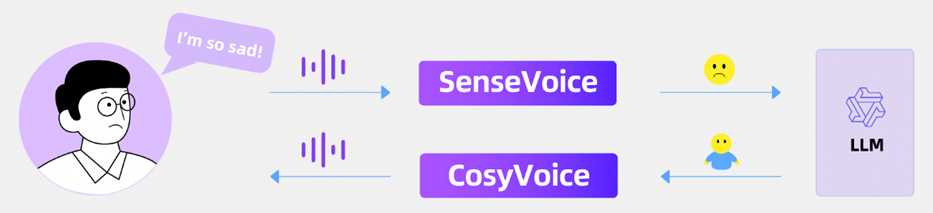

强情感交互的语音对话

通过融合SenseVoice、大型语言模型(LLMs)和CosyVoice,能够支持开发一款情感语音聊天应用程序。

当SenseVoice解析出情绪/情感/咳嗽等副语言信息后,大模型输出相对应的反馈情绪,并由CosyVoice合成出适当的声音情绪,从而完成舒适自然的对话交互过程。在以下示例中,用户和助手的所有对话内容均由CosyVoice合成。

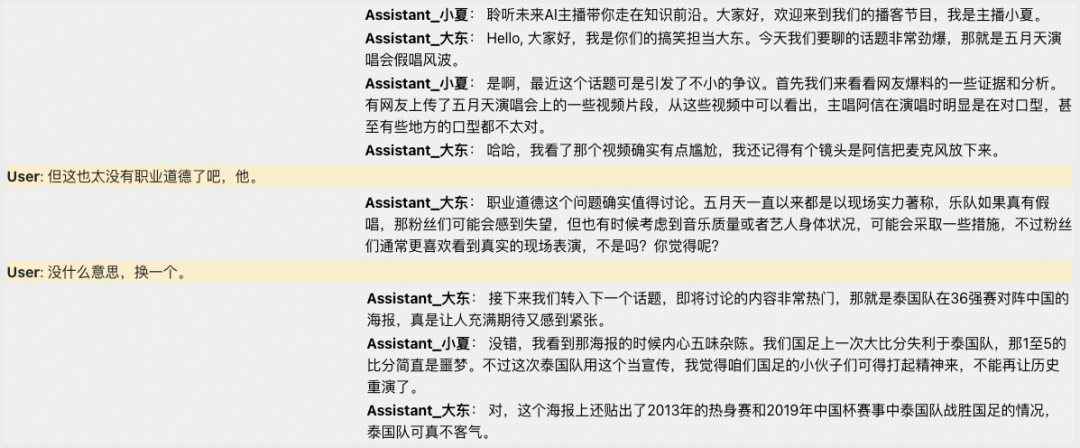

专属AI博客电台

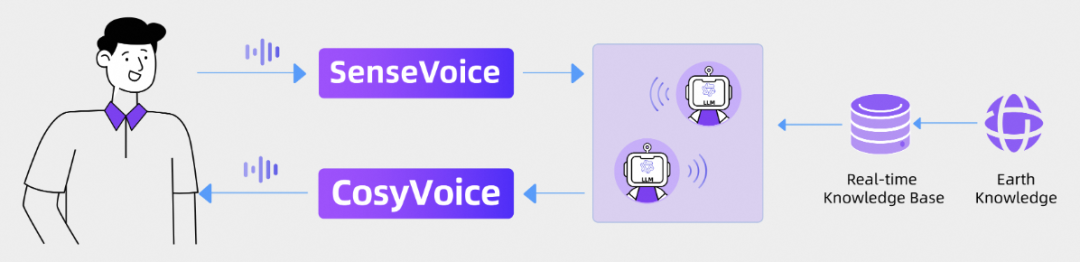

通过将SenseVoice、基于LLM的具有实时世界知识的多代理系统和CosyVoice整合,我们能够创造一个互动式播客电台。

在这样的播客中,SenseVoice利用其高精度多语言语音识别功能,实时捕捉AI播客和用户的对话,甚至能够辨识环境音效和情感。LLM多代理系统则能够处理SenseVoice提供的语音数据,实时更新世界知识库,确保话题和信息的及时性和准确性。

在交互中,用户可以随时打断AI播客的对话,引导主题方向等,CosyVoice将用于生成AI播客的语音,具备多种语言、音色和情感的控制能力,为听众带来丰富多彩的听觉体验。

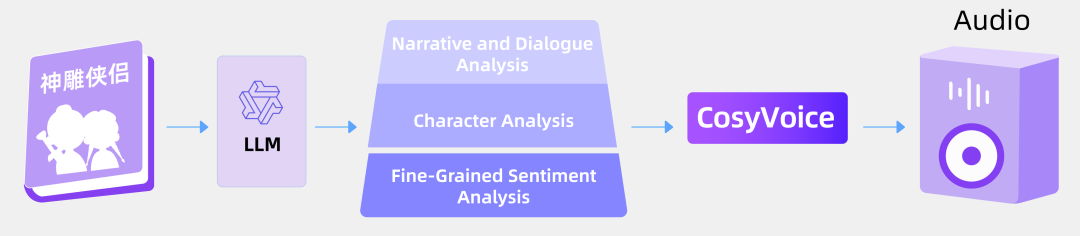

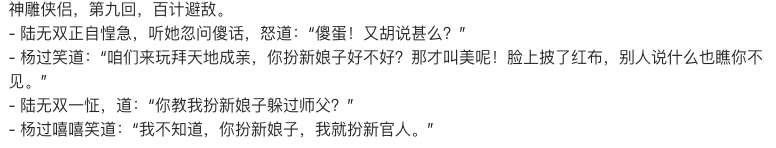

有声读物

借助LLMs出色的分析能力,可对书籍内容进行结构化并识别其中的情感,再与CosyVoice的语音合成技术结合,我们能够实现具有更高表现力的有声读物。

LLMs深入理解文本,捕捉每一个情感波动和故事弧线,而CosyVoice则将这些情感细腻地转化为语音,带有特定的情绪色彩和强调,为听众提供一个不仅丰富多彩而且情感充沛的听觉体验。

这样的有声读物不再是单一无变化的朗读,而是一场充满情感与生动表达的听觉盛宴,让每个故事和角色都栩栩如生。

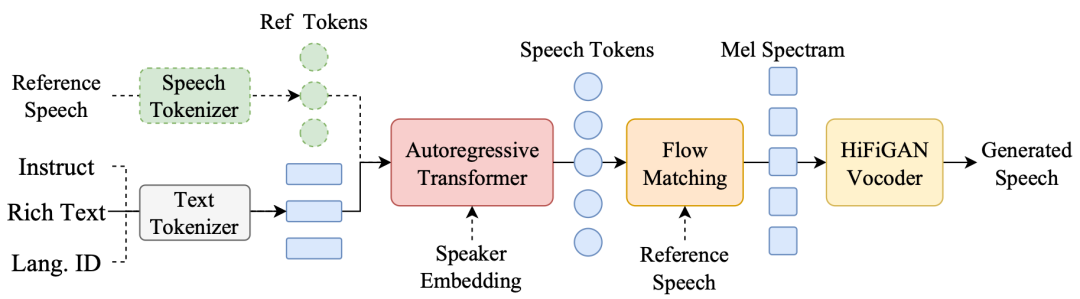

CosyVoice

CosyVoice是一款基于语音量化编码的语音生成大模型。它对语音进行离散化编码,并依托大模型技术,实现自然流畅的语音合成体验。与传统语音合成技术相比,CosyVoice具有韵律自然、音色逼真等特点。CosyVoice支持多达5种语言,同时还支持以自然语言或富文本形式对合成语音进行情感等维度的细粒度控制。我们提供了基模型CosyVoice-300M、经过SFT微调后的模型CosyVoice-300M-SFT、以及支持细粒度控制的模型CosyVoice-300M-Instruct,可满足不同场景下的使用需求。

研究团队还使用预训练的情感分类模型评价了CosyVoice的情感控制能力,主要包括高兴/悲伤/生气/害怕/反感等5种高表现力的语音情感。CosyVoice-300M本身具备一定从文本内容中推断情感的能力,经过细粒度控制训练的模型CosyVoice-300M-Instruct在情感分类中的得分更高,具备更强的情感控制能力。

SenseVoice

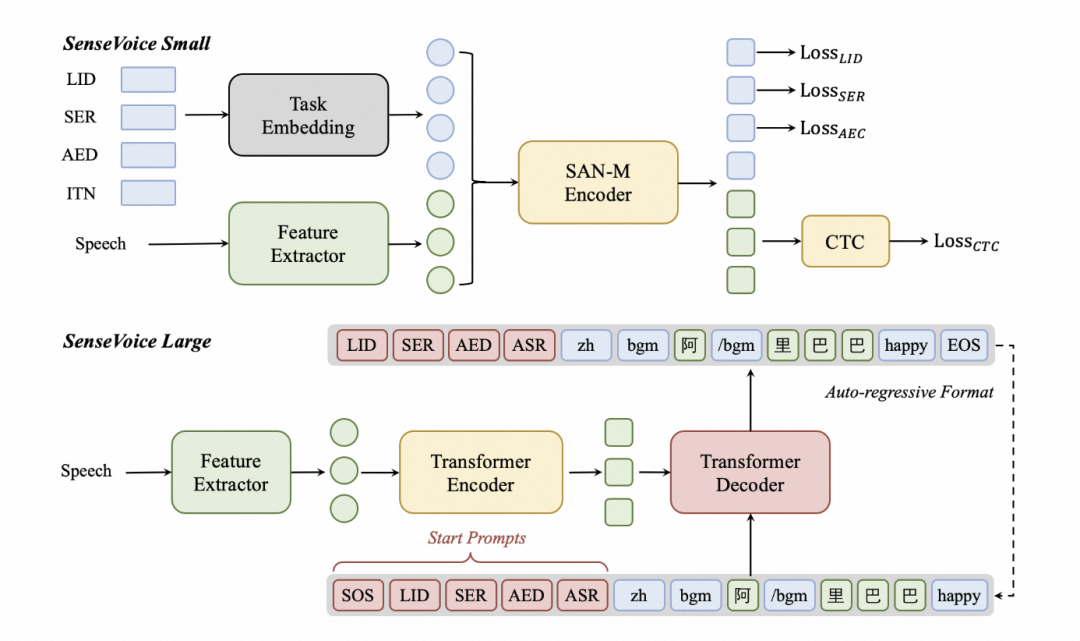

SenseVoice是一个基础语音理解模型,具备多种语音理解能力,涵盖了自动语音识别(ASR)、语言识别(LID)、情感识别(SER)以及音频事件检测(AED)。该模型旨在提供全面的语音处理功能,从而支持构建更复杂的语音交互系统。

SenseVoice-Small 是一款仅含编码器的轻量级基础语音模型,设计用于快速语音理解。它可以快速处理语音数据,并在有需要时迅速做出响应,适用于对延迟敏感的应用场合,如实时语音交互系统。SenseVoice-Large 则是一个包含编码器和解码器的大型基础语音模型。这个版本的SenseVoice专注于更精确的语音理解,拥有对更多语言的支持能力。它适合于对识别精度有更高要求的场景,可以处理更复杂的语音输入,并生成更为准确的结果。

SenseVoice-Small与SenseVoice-Large模型都能在语音中检测音频事件,包括音乐、掌声和笑声。SenseVoice-Large模型除了能够预测音频事件的类型,还能精准识别事件发生的起始和结束位置。与之相比,SenseVoice-Small模型虽然仅能预测音频中发生的事件类型(仅限于一个事件),但它能够检测到更多种类的事件,诸如在人机互动过程中可能出现的咳嗽、打喷嚏、呼吸和哭泣等。

CosyVoice和SenseVoice相关的模型已在ModelScope上开源,同时在GitHub上发布了相应的训练、推理和微调代码,欢迎大家体验!

CosyVoice

<一起在线体验>

选择预制的几个不同性别/语种的音色,输入文本合成试听效果(可尝试输入[laughter],触发彩蛋~)

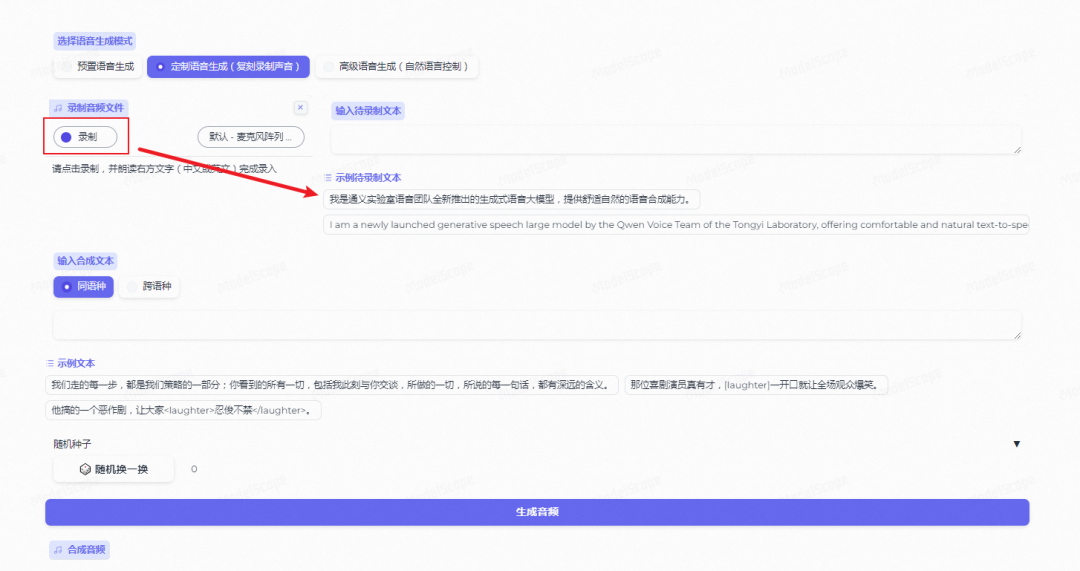

直接录一句话,即可用自己的音色输出更多合成文本,支持下载~

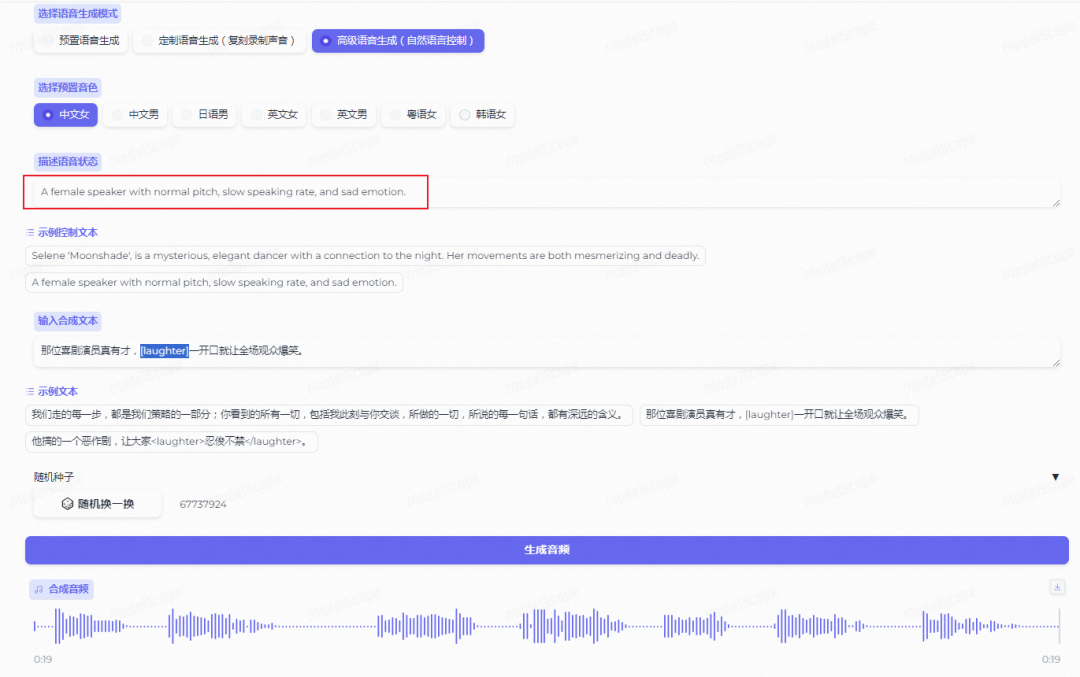

在【预置语音生成】功能的基础上,可通过自定义情绪、语速等修饰,让合成文本的情景感更可控、生动。

效果试听:

SenseVoice

开源仓库:https://github.com/FunAudioLLM/SenseVoice

模型地址:https://www.modelscope.cn/models/iic/SenseVoiceSmall

在线体验:https://www.modelscope.cn/studios/iic/SenseVoice

小程序体验:

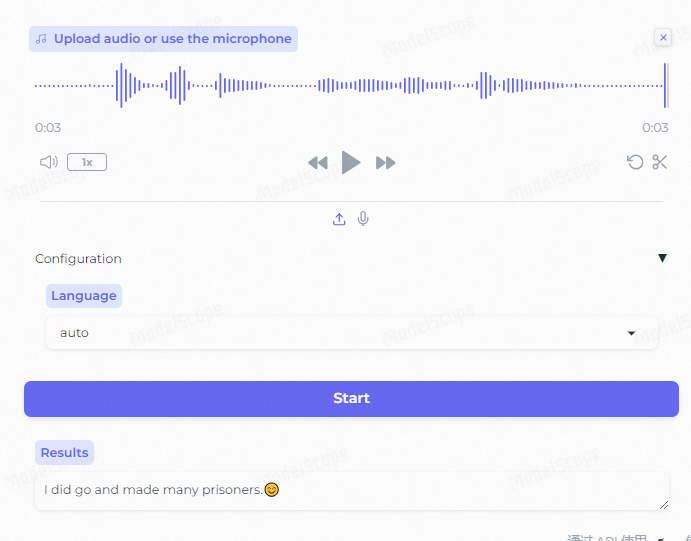

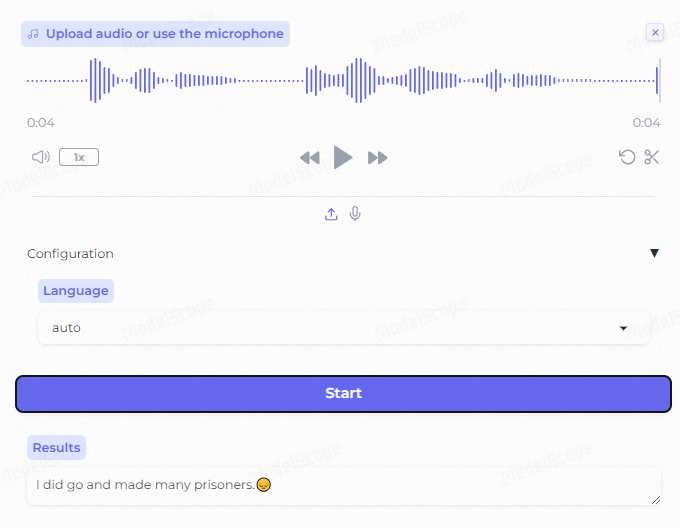

上传音频文件或通过麦克风输入,选择任务和语言

音频将被转录成相应的文本,并附带相关情感(? 高兴,? 生气/激动,? 悲伤) 和 声音事件类型(? 笑声,? 音乐,? 掌声,? 咳嗽&打喷嚏,? 哭泣)

让我们来试试同一句话的两个不同情绪的识别效果:

粤ICP备17114055号

粤ICP备17114055号